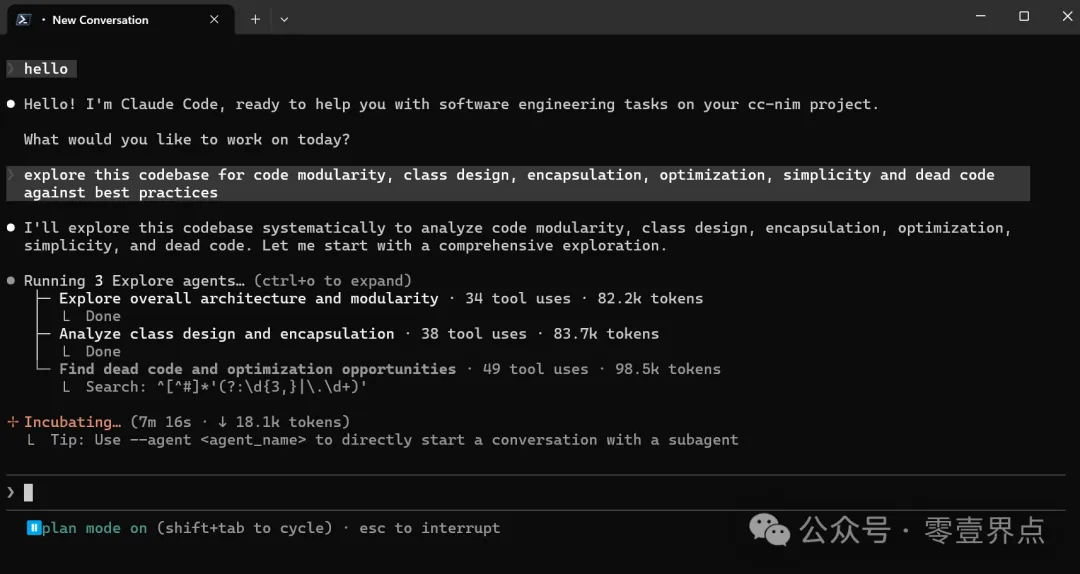

free-claude-code 让Claude Code真的免费用起来

本文从工具机制拆解的视角出发,解释 free-claude-code 如何利用 Claude Code 的官方配置项对接免费 LLM 后端,帮你判断这条路是否适合自己的场景。

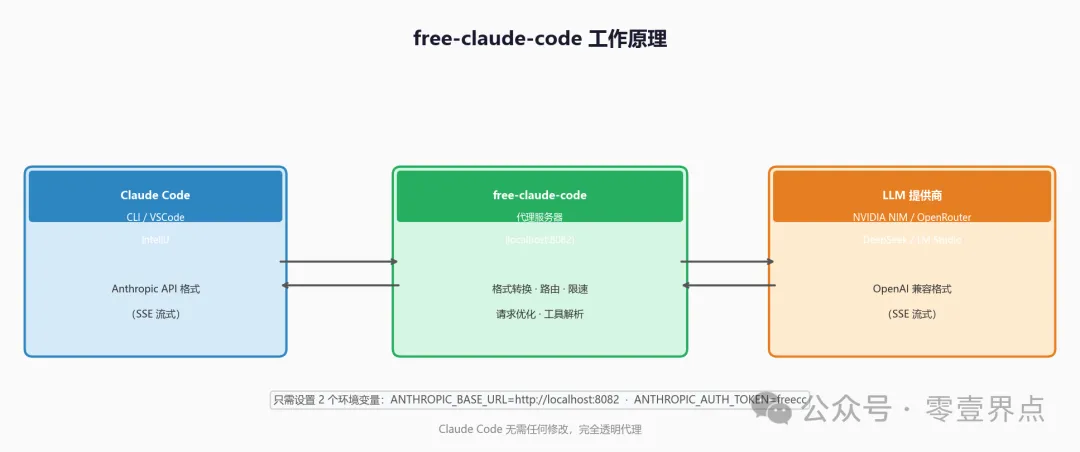

1、一个环境变量,接管 Claude Code 的所有请求

Claude Code 在设计上预留了一个出口:ANTHROPIC_BASE_URL。默认值指向 Anthropic 服务器,但把它改成本地代理地址,Claude Code 就会把所有 API 请求打过去——它认不出后端换了,照常工作。

free-claude-code 就是那个本地代理。它在 :8082 端口监听,把 Claude Code 发来的 Anthropic 格式请求,翻译成 OpenAI 兼容格式,转发给 NVIDIA NIM、OpenRouter 或本地模型,再把响应原路翻回来。整个链路对 Claude Code 透明。

这不是破解,也不是逆向——ANTHROPIC_BASE_URL 本来就是 Claude Code 官方文档里的配置项,设计用来支持私有化部署场景。free-claude-code 只是把这个口子用在了接入免费公共 API 上。

启动只需两步:本地起代理,Claude Code 启动时带上两个环境变量。

# 终端 1:启动代理

uv run uvicorn server:app --host 0.0.0.0 --port 8082

# 终端 2:启动 Claude Code

ANTHROPIC_AUTH_TOKEN="freecc" ANTHROPIC_BASE_URL="http://localhost:8082" claude

VSCode 和 IntelliJ 插件同样支持,在设置里加两个环境变量即可,不需要其他改动。

重点:改变的只是

ANTHROPIC_BASE_URL的值,Claude Code 本身零修改。但后端模型的能力上限决定了实际体验,简单任务和复杂多文件重构的差距真实存在。

2、格式转换、请求拦截与模型路由

代理在中间做的事不只是转发。

格式转换是核心工作。Claude Code 说 Anthropic 方言,各后端说 OpenAI 方言,两者格式不同。代理把请求翻译过去,把响应翻译回来,包括 <think> 标签和 reasoning_content 字段——这些推理内容会被还原成 Claude 原生的 thinking block,在界面上照常显示。

请求拦截是实际节省配额的关键。Claude Code 运行时会发出大量跟编程任务无关的背景请求——网络探测、对话标题生成、前缀检测、自动建议、文件路径提取,共 5 类。代理全部本地拦截,直接返回预设响应,不转发出去。NVIDIA NIM 每分钟 40 次的配额,被这 5 类请求消耗的比例很低,实际可用量远高于字面数字。

模型路由让三个槽位各自独立。.env 里 MODEL_OPUS、MODEL_SONNET、MODEL_HAIKU 可以分别指向不同提供商和模型,混用没有限制。Claude Code 发 Opus 请求时走一个后端,发 Haiku 请求时走另一个,互不干扰。

还有一个工具调用解析器(Heuristic Tool Parser):Claude Code 高度依赖文件读写、命令执行等工具调用,这要求后端模型输出标准 JSON 格式的 function call。有些模型会把工具调用混在自然语言里输出,代理会尝试从中提取并格式化——这个解析器不能兜住所有情况,但能让一批原本不可用的模型勉强可用。

重点:5 类请求本地拦截是配额效率的关键;工具调用解析器是低兼容模型的补丁,选原生支持 function call 的模型可以不依赖它。

3、NVIDIA NIM 首选,OpenRouter 备用,本地模型兜底

NVIDIA NIM 是起步的最优解。免费账号,每分钟 40 次请求,可用模型包括 Kimi K2.5、GLM5、Qwen3.5-397B、Step-3.5-Flash、MiniMax M2.5。这些模型对编程任务的支持都算稳定,日常写代码、改 bug、解释逻辑,40 req/min 在请求优化开启后基本够用。参见本公众号之前发的文章《不花一分钱用 Claude Code!NVIDIA 免费算力 + 2300 亿参数,手把手教你搞定》

OpenRouter 的价值是模型多。deepseek/deepseek-r1-0528:free 和 openai/gpt-oss-120b:free 都在免费档,可以直接配进 .env。免费档有时会有队列延迟,NIM 额度耗尽或某个模型下线时,OpenRouter 是最顺手的接替方案。

LM Studio 和 llama.cpp 解决的是另一类需求:数据不出本机、没有速率限制。代价是显存。GLM-4.7-Flash 的 GGUF 量化版在 12GB 显存上可以跑;Qwen3.5-35B-A3B 需要 24GB。本地模型对编程任务的质量与模型本身相关,不是所有本地模型都能稳定完成复杂的 agentic 工作流——选之前先用简单任务测一下工具调用是否正常。

混用策略比单一后端灵活:把 Opus 槽位指向 NIM 里质量最高的模型(Kimi K2.5 或 MiniMax M2.5),Haiku 槽位指向本地轻量模型。Opus 槽位的请求频率最低,配给最强的免费模型性价比最高。

MODEL_OPUS="nvidia_nim/moonshotai/kimi-k2.5"

MODEL_SONNET="open_router/deepseek/deepseek-r1-0528:free"

MODEL_HAIKU="lmstudio/unsloth/GLM-4.7-Flash-GGUF"

重点:从 NVIDIA NIM 单后端开始,跑一周看 40 req/min 是否满足,不够再引入 OpenRouter 或本地模型补充——不要一开始就配复杂的混用方案。

4、工具链与模型解耦

Claude Code 的核心价值不是 Claude 模型本身,而是它的工具链——读写文件、执行命令、理解项目结构、管理跨文件上下文。free-claude-code 的存在说明这套工具链可以脱离 Anthropic 后端独立运行。

对个人开发者来说,实际意义很具体:日常任务走 NIM 免费额度,遇到需要最强推理能力的复杂重构切回官方 Claude API,代码涉及敏感数据时用本地模型。Per-Model 路由把这个切换做成了改三行 .env 的事。

这条路有一个真实的能力上限需要认清:Claude Sonnet 4.5 / Opus 4.7 在跨十几个文件的系统级重构、超长上下文追踪上的表现,目前没有任何免费替代品能完全匹配。free-claude-code 能替代的是 80% 的日常场景,剩下 20% 的高强度任务,官方订阅仍然有价值。

重点:工具链可以解耦不等于能力对等——用 free-claude-code 覆盖日常,保留官方账号应对复杂任务,是比全量替代更务实的用法。

项目地址:https://github.com/Alishahryar1/free-claude-code

NVIDIA NIM API Key 申请:参见本公众号之前发的文章《不花一分钱用 Claude Code!NVIDIA 免费算力 + 2300 亿参数,手把手教你搞定》

OpenRouter 免费模型列表:https://openrouter.ai/collections/free-models

文章来源:https://mp.weixin.qq.com/s/Utt_upkdbUnU1b1pz1Rw-Q

布施恩德可便相知重

微信扫一扫打赏

支付宝扫一扫打赏